2025. 1. 31.

🔐 AI 보안 강화: CUBIG의 합성 데이터 및 LLM 캡슐

대형 언어 모델(LLM) 보안에 대한 우려가 급속히 커지고 있습니다.

최근 사례 — DeepSeek의 AI 모델이 특정 국가에서 금지된 사건 및 OpenAI의 데이터 수집 관행 — 은 데이터 유출 🔓, 무단 저장 및 숨겨진 백도어의 위험을 강조합니다.

이는 기업과 개인 사용자 모두에게 심각한 위협이 됩니다.

⚠️ 왜 더 강력한 AI 보안이 필요한가

일부 기업들이 자체적으로 안전한 LLM을 구축하려고 시도하고 있지만, 이는 완전한 해결책이 아닙니다.

- 민감한 훈련 데이터는 여전히 노출될 수 있습니다.

- 백도어 공격은 심지어 개인 모델조차도 위험에 빠뜨릴 수 있습니다.

필요한 것은 모델뿐만 아니라 이들이 학습하는 데이터도 보호하는 포괄적인 접근 방식 🛡️입니다.

🛠️ CUBIG의 솔루션: DTS 및 LLM 캡슐

CUBIG는 두 가지 핵심 기술로 이러한 과제를 해결합니다:

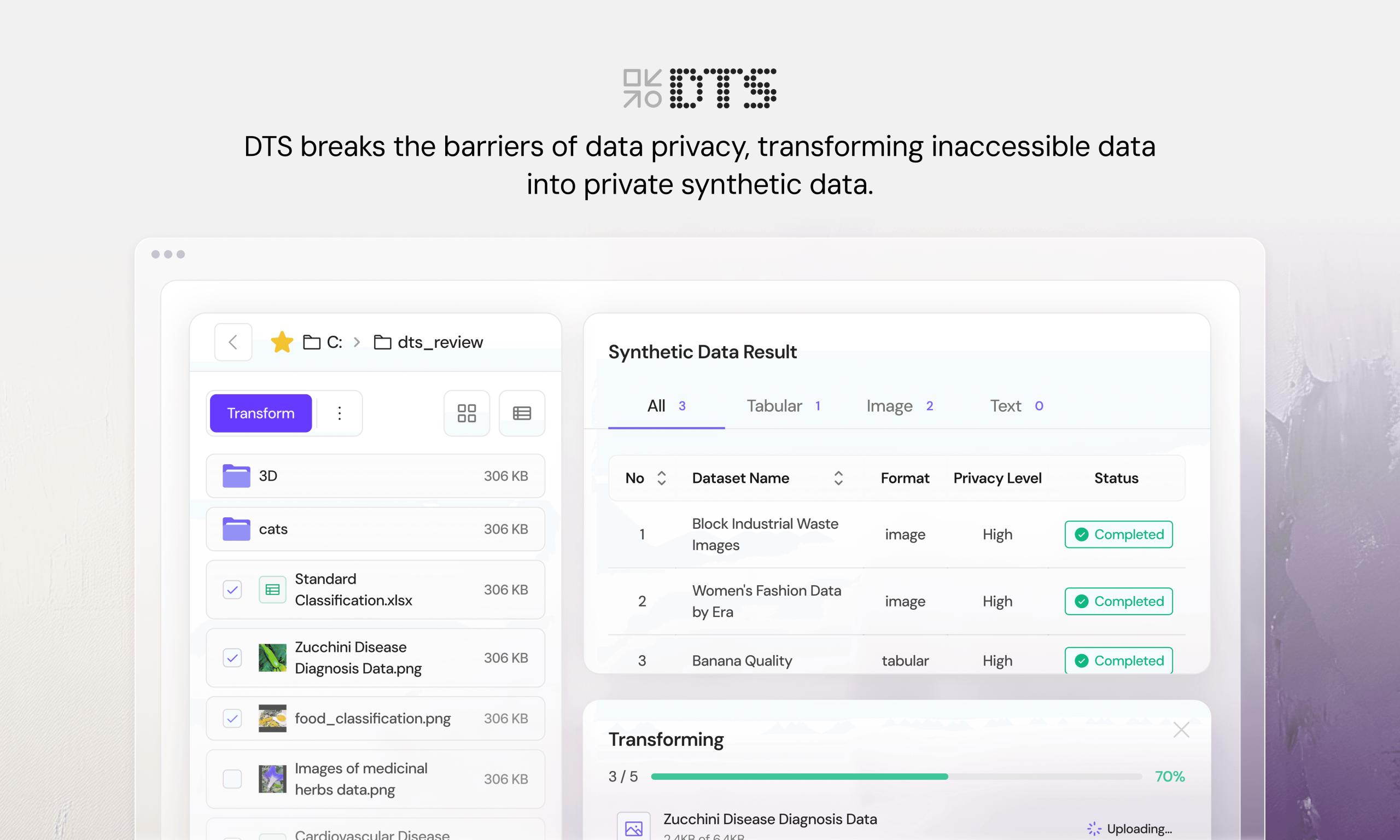

- DTS (데이터 변환 시스템): 민감한 정보를 제거하면서 원본 데이터셋의 유용성을 최대 99%까지 유지하는 개인 정보 보호 합성 데이터를 생성합니다.

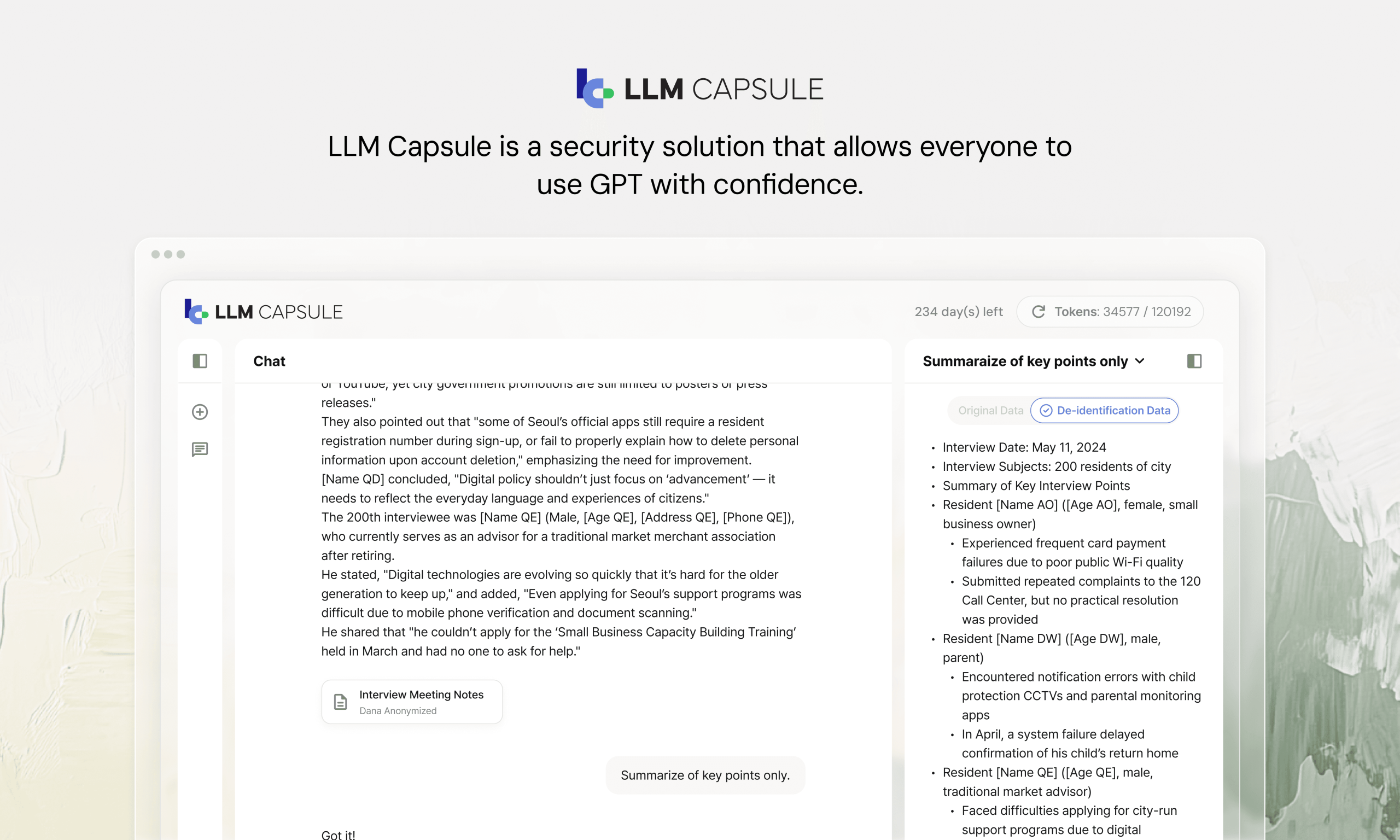

- LLM 캡슐: 보안 필터 🔍 역할을 하며, 입력 단계에서 개인 정보를 감지하고 익명화하여 기업과 개인 모두 안전한 AI 챗봇 사용을 보장합니다.

🤝 AI에 대한 신뢰 구축

사용자는 보다 신중한 사고방식을 채택해야 합니다:

- AI 서비스에 민감한 데이터 🔒를 입력하지 마십시오.

- 데이터 수집 및 저장 정책을 검토하십시오.

- CUBIG의 LLM 캡슐과 같은 보호 도구를 구현하십시오.

안전한 합성 데이터와 실시간 필터링을 결합함으로써, CUBIG는 개인 정보가 절대적으로 보호되는 더 안전한 AI 생태계를 형성하는 데 도움을 주고 있습니다.

📎 더 읽기

전체 기사 읽기(클릭)📰